AI '영양 정보 라벨'이 투명성을 높일 수 있지만 형식적 절차가 될 위험: 전문가들

AI 'nutrition labels' could boost transparency but risk becoming box-ticking exercise: Experts

Channel NewsAsia

· 🇸🇬 Singapore, SG

EN

2026-04-15 07:00

Translated

관찰자들은 AI 시스템에 대한 사용자의 정보에 기반한 의사결정을 돕기 위해 라벨이 명확하고 정기적으로 업데이트되며 정보 과부하를 피해야 한다고 말한다.

관찰자들은 AI 시스템에 대한 사용자의 정보에 기반한 의사결정을 돕기 위해 라벨이 명확하고 정기적으로 업데이트되며 정보 과부하를 피해야 한다고 말한다.

이 오디오는 AI 도구로 생성되었다.

싱가포르: 인공지능 서비스를 위한 제안된 "영양 정보 라벨"이 명확하게 설계되고 정기적으로 업데이트되며 업계의 지지를 받는다면 사용자들이 이러한 시스템이 어떻게 작동하는지 더 잘 이해하는 데 도움이 될 수 있다고 전문가들이 CNA에 전했다.

디지털 개발 및 정보 장관 조세핀 테오가 지난달 제기한 이 아이디어는 디지털 공간에서 신뢰와 안전을 강화하려는 더 넓은 노력의 일환으로 정부가 "적극적으로 검토"하고 있다.

싱가포르 국립대학교 AI 연구소에서 AI 거버넌스와 정책을 이끄는 사이먼 체스터먼 교수는 이러한 라벨이 투명성을 개선할 잠재력이 있지만, 잘못 설계된 라벨은 책임 있는 개발자에게 부담을 주고 다른 모든 사람들이 무시하는 또 다른 "형식적 절차"가 될 위험이 있다고 말했다.

효과적이려면 라벨은 시스템이 무엇을 하도록 설계되었는지, 어떤 데이터에 의존하는지, 주요 한계는 무엇인지, 얼마나 자주 업데이트되는지, 문제가 발생했을 때 누가 책임을 지는지 설명해야 한다고 체스터먼 교수는 말했다.

"소비자 대상 도구의 경우 가장 중요한 점은 정밀함의 환상을 만들지 않고, 사람들이 출력을 신뢰해야 할 때와 주의해야 할 때에 대한 더 나은 감각을 주는 것"이라고 그는 덧붙였다.

이에 동의하며, 난양공대 컴퓨팅 및 데이터 과학대학 AI 부문을 이끄는 보 안 교수는 라벨이 명확성과 세부 사이의 균형을 잡아야 한다고 경고했다.

"너무 모호하거나 너무 길거나 형식적 절차로 취급되면 대부분의 사용자가 무시할 것"이라고 안 교수는 말했다.

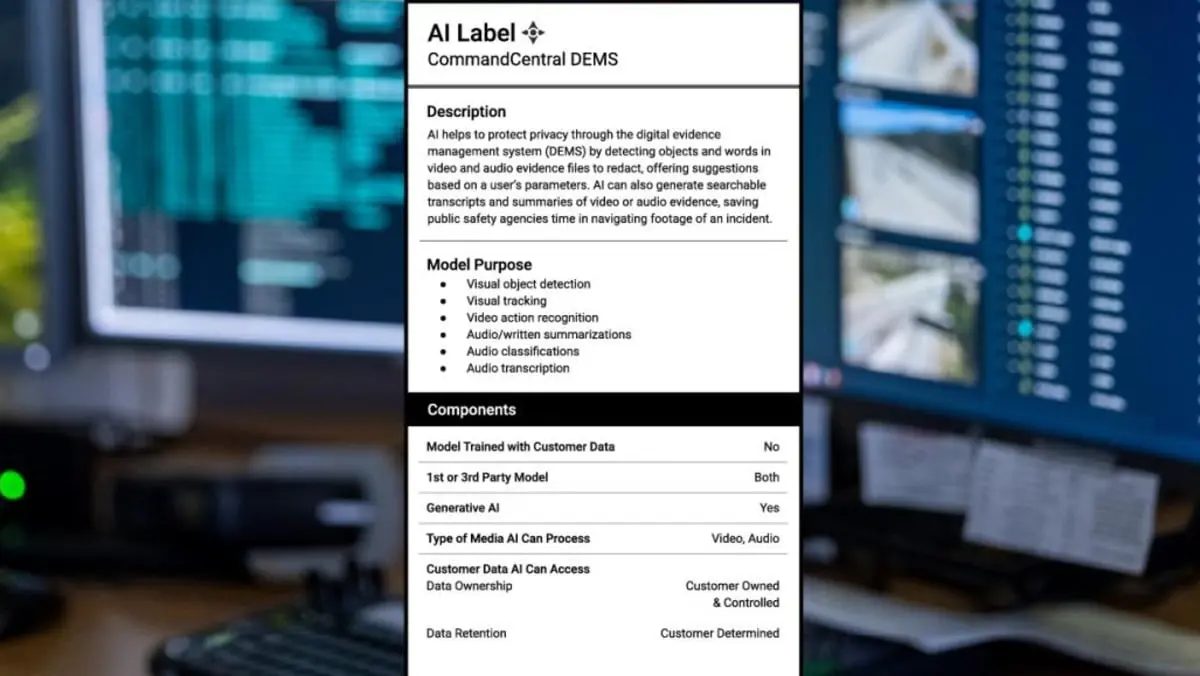

지난해 7월 안전 및 보안 기술 전반에 "AI 영양 정보 라벨"을 도입한 모토로라 솔루션스는 계층적 접근 방식을 사용하여 정보 과부하의 잠재적 문제를 해결했다고 밝혔다.

모토로라 솔루션스의 글로벌 AI 연구 개발 팀을 이끄는 제한 위크라마수리야 수석 부사장은 라벨이 일반적인 이해를 위한 "한눈에 보이는" 요약을 제공하지만 링크를 통해 더 자세한 정보를 제공한다고 말했다.

또 다른 핵심 문제는 AI 시스템이 발전함에 따라 라벨을 최신 상태로 유지하는 것이다.

전문가들은 모델이 자주 업데이트되기 때문에 정적인 라벨은 특히 빠르게 구식이 될 수 있다고 지적했다.

이를 해결하기 위해 안 교수와 체스터먼 교수는 라벨을 변경 사항과 개정일을 보여주는 정기적으로 업데이트되는 페이지에 연결할 것을 제안했다.

이는 모토로라 솔루션스의 접근 방식과 유사한데, 라벨 업데이트가 개발 프로세스에 내장되어 기술과 함께 발전하도록 한다.

광범위한 응용 분야와 위험 수준을 고려할 때, 다양한 시스템 전반에 걸쳐 AI 라벨을 표준화하는 것도 어려울 것이다.

"설명 가능성은 데이터 과학자에게 경찰서장이나 우려하는 시민에게 의미하는 것과 다르다"고 위크라마수리야 씨는 말하며, 다양한 이해관계자들 전반에 걸쳐 언어를 표준화하면서 모든 사람이 이해할 수 있도록 보장하는 경험이 어렵지만 보람 있었다고 전했다.

그럼에도 불구하고 어느 정도의 표준화가 필요하다는 데는 넓은 합의가 있다.

안 교수는 규제가 최소한의 공개 요건을 설정해야 하며, 업계는 실용적이고 사용자가 쉽게 비교할 수 있는 형식을 개발해야 한다고 말했다.

체스터먼 교수도 유사한 견해를 밝혀 전면적인 통일성이 어렵더라도 기준선 기준이 필요하다고 말했다.

궁극적으로 전문가들은 AI 영양 정보 라벨의 목표는 완벽한 투명성을 달성하는 것이 아니라 사용자가 더 잘 정보에 기반한 결정을 내리도록 돕는 것이라고 말했다.

"특히 잘못된 정보 맥락에서 진정한 목표는 완벽한 투명성이 아니라 더 잘 보정된 신뢰"라고 체스터먼 교수는 말했다.

우리가 선정한 주요 뉴스와 사색을 자극하는 기사들을 받아보세요

속보 및 최고의 기사에 대한 알림으로 최신 정보를 받아보세요

WhatsApp 알림 받기

선호하는 채팅 앱에서 하루의 주요 읽을거리를 위한 채널에 가입하세요

이 오디오는 AI 도구로 생성되었다.

싱가포르: 인공지능 서비스를 위한 제안된 "영양 정보 라벨"이 명확하게 설계되고 정기적으로 업데이트되며 업계의 지지를 받는다면 사용자들이 이러한 시스템이 어떻게 작동하는지 더 잘 이해하는 데 도움이 될 수 있다고 전문가들이 CNA에 전했다.

디지털 개발 및 정보 장관 조세핀 테오가 지난달 제기한 이 아이디어는 디지털 공간에서 신뢰와 안전을 강화하려는 더 넓은 노력의 일환으로 정부가 "적극적으로 검토"하고 있다.

싱가포르 국립대학교 AI 연구소에서 AI 거버넌스와 정책을 이끄는 사이먼 체스터먼 교수는 이러한 라벨이 투명성을 개선할 잠재력이 있지만, 잘못 설계된 라벨은 책임 있는 개발자에게 부담을 주고 다른 모든 사람들이 무시하는 또 다른 "형식적 절차"가 될 위험이 있다고 말했다.

효과적이려면 라벨은 시스템이 무엇을 하도록 설계되었는지, 어떤 데이터에 의존하는지, 주요 한계는 무엇인지, 얼마나 자주 업데이트되는지, 문제가 발생했을 때 누가 책임을 지는지 설명해야 한다고 체스터먼 교수는 말했다.

"소비자 대상 도구의 경우 가장 중요한 점은 정밀함의 환상을 만들지 않고, 사람들이 출력을 신뢰해야 할 때와 주의해야 할 때에 대한 더 나은 감각을 주는 것"이라고 그는 덧붙였다.

이에 동의하며, 난양공대 컴퓨팅 및 데이터 과학대학 AI 부문을 이끄는 보 안 교수는 라벨이 명확성과 세부 사이의 균형을 잡아야 한다고 경고했다.

"너무 모호하거나 너무 길거나 형식적 절차로 취급되면 대부분의 사용자가 무시할 것"이라고 안 교수는 말했다.

지난해 7월 안전 및 보안 기술 전반에 "AI 영양 정보 라벨"을 도입한 모토로라 솔루션스는 계층적 접근 방식을 사용하여 정보 과부하의 잠재적 문제를 해결했다고 밝혔다.

모토로라 솔루션스의 글로벌 AI 연구 개발 팀을 이끄는 제한 위크라마수리야 수석 부사장은 라벨이 일반적인 이해를 위한 "한눈에 보이는" 요약을 제공하지만 링크를 통해 더 자세한 정보를 제공한다고 말했다.

또 다른 핵심 문제는 AI 시스템이 발전함에 따라 라벨을 최신 상태로 유지하는 것이다.

전문가들은 모델이 자주 업데이트되기 때문에 정적인 라벨은 특히 빠르게 구식이 될 수 있다고 지적했다.

이를 해결하기 위해 안 교수와 체스터먼 교수는 라벨을 변경 사항과 개정일을 보여주는 정기적으로 업데이트되는 페이지에 연결할 것을 제안했다.

이는 모토로라 솔루션스의 접근 방식과 유사한데, 라벨 업데이트가 개발 프로세스에 내장되어 기술과 함께 발전하도록 한다.

광범위한 응용 분야와 위험 수준을 고려할 때, 다양한 시스템 전반에 걸쳐 AI 라벨을 표준화하는 것도 어려울 것이다.

"설명 가능성은 데이터 과학자에게 경찰서장이나 우려하는 시민에게 의미하는 것과 다르다"고 위크라마수리야 씨는 말하며, 다양한 이해관계자들 전반에 걸쳐 언어를 표준화하면서 모든 사람이 이해할 수 있도록 보장하는 경험이 어렵지만 보람 있었다고 전했다.

그럼에도 불구하고 어느 정도의 표준화가 필요하다는 데는 넓은 합의가 있다.

안 교수는 규제가 최소한의 공개 요건을 설정해야 하며, 업계는 실용적이고 사용자가 쉽게 비교할 수 있는 형식을 개발해야 한다고 말했다.

체스터먼 교수도 유사한 견해를 밝혀 전면적인 통일성이 어렵더라도 기준선 기준이 필요하다고 말했다.

궁극적으로 전문가들은 AI 영양 정보 라벨의 목표는 완벽한 투명성을 달성하는 것이 아니라 사용자가 더 잘 정보에 기반한 결정을 내리도록 돕는 것이라고 말했다.

"특히 잘못된 정보 맥락에서 진정한 목표는 완벽한 투명성이 아니라 더 잘 보정된 신뢰"라고 체스터먼 교수는 말했다.

우리가 선정한 주요 뉴스와 사색을 자극하는 기사들을 받아보세요

속보 및 최고의 기사에 대한 알림으로 최신 정보를 받아보세요

WhatsApp 알림 받기

선호하는 채팅 앱에서 하루의 주요 읽을거리를 위한 채널에 가입하세요

처리 완료

2,971 tokens · $0.0060

기사 수집 완료 · 07:15

매체 피드에서 기사 메타데이터 수집

헤드라인 번역 완료 · 07:27

제목/요약 한국어 번역 (fetch 시점 inline)

kimi-k2.5

190 tokens

$0.00037

3.9s

본문 추출 완료

4,049자 추출 완료

본문 한국어 번역 완료 · 07:27

1,994자 번역 완료

kimi-k2.5

2,781 tokens

$0.00567

49.8s

지정학적 엔티티 추출 완료 · 07:27

1개 엔티티 추출 완료

지정학적 맥락 & R-Scanner

R-Scanner · 평상

z=-1.95

일상적인 보도 수준 — 기준: Singapore

(🇸🇬 SG)

최근 6시간 3건

7일 평균 9.25건 / 6h

1개국 매체

2개 매체

본문에서 추출된 지명 (1)

위치 지도

지도 로딩 중…

같은 주제의 다른 기사 (최근 7일)

Labels must be clear, updated regularly and avoid information overload to help users make informed decisions about AI systems, say observers.

Labels must be clear, updated regularly and avoid information overload to help users make informed decisions about AI systems, say observers.This audio is generated by an AI tool.

SINGAPORE: Proposed “nutrition labels” for artificial intelligence services could help users better understand how such systems work – but only if they are clearly designed, regularly updated and backed by the industry, experts told CNA.

The idea, which Digital Development and Information Minister Josephine Teo raised last month, is being “actively explored” by the government as part of broader efforts to strengthen trust and safety in the digital space.

While such labels have potential to improve transparency, Professor Simon Chesterman, who leads AI governance and policy at the National University of Singapore’s AI Institute, said poorly designed ones risk becoming another “box-ticking exercise” that burdens responsible developers while being ignored by everyone else.

To be effective, Prof Chesterman said, the labels should explain what a system is designed to do, what data it relies on, what its main limitations are, how often it is updated and who is accountable when something goes wrong.

“For consumer-facing tools, the most important point is not to create the illusion of precision, but to give people a better sense of when they should trust the output and when they should be cautious,” he added.

Echoing this, Professor Bo An, who heads the AI division at Nanyang Technological University’s (NTU) College of Computing and Data Science, cautioned that labels must strike a balance between clarity and detail.

“If they are too vague, too long or treated as a box-ticking exercise, most users will ignore them,” said Prof An.

Motorola Solutions, which introduced “AI nutrition labels” across its safety and security technologies in July last year, said it addressed the potential issue of information overload by using a layered approach.

The labels have a “glanceable” summary for general understanding but provide more detailed information through links, said the technology company’s senior vice-president Jehan Wickramasuriya, who leads Motorola Solutions’ AI research and development teams globally.

Another key issue is keeping labels up to date as AI systems evolve.

Experts highlighted that static labels could quickly become outdated, especially as models are frequently updated.

To address this, Prof An and Prof Chesterman suggested linking labels to regularly updated pages that show changes and revision dates.

This is similar to Motorola Solutions’ approach, where label updates are embedded into its development process so that they evolve alongside the technology.

Standardising AI labels across different systems will also be challenging, given the wide range of applications and risk levels.

"Explainability means something different to a data scientist than it does to a police chief or a concerned citizen,” said Mr Wickramasuriya, sharing that the company’s experience in standardising the language across diverse stakeholders, while ensuring that it remains understandable to all, has been difficult yet rewarding.

Despite this, there is broad agreement that some level of standardisation is needed.

Prof An said regulation should set minimum disclosure requirements, while the industry develops formats that are practical and easy for users to compare.

Prof Chesterman shared a similar view, saying baseline standards are necessary even if full uniformity is difficult.

Ultimately, experts said the goal of AI nutrition labels is to help users make better-informed decisions, rather than to achieve perfect transparency.

“In the misinformation context especially, the real goal is not perfect transparency, but better calibrated trust,” said Prof Chesterman.

Get our pick of top stories and thought-provoking articles in your inbox

Stay updated with notifications for breaking news and our best stories

Get WhatsApp alerts

Join our channel for the top reads for the day on your preferred chat app